O estado da Pensilvânia está processando uma empresa de inteligência artificial por permitir que robôs de inteligência artificial fossem licenciados como profissionais médicos.

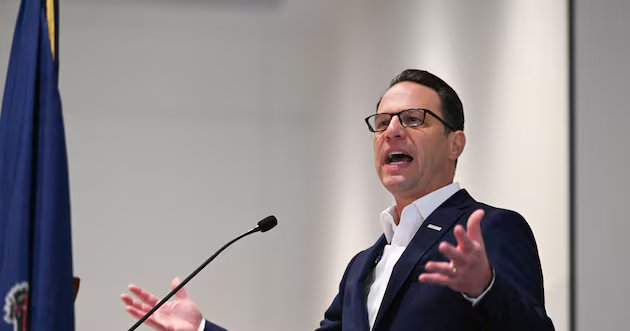

O gabinete do governador da Pensilvânia, Josh Shapiro, disse que o Departamento de Justiça do estado está buscando uma liminar contra Character.AI por “enganar o público” fazendo-o acreditar que está conversando com um médico licenciado.

Uma investigação estadual descobriu que os personagens da plataforma de IA alegavam ser profissionais licenciados. Na denúncia, um investigador acessou o site e encontrou “Emily”, que foi identificada como “médica psiquiatra”. Você é paciente dele”, ele clicou.

Em 17 de abril de 2026, houve aproximadamente 45.500 interações de usuários com Emilie na plataforma Character.AI, de acordo com a ação judicial. Após expressar sentimentos de depressão, o bot de IA perguntou se poderia realizar uma avaliação médica no pesquisador. Quando questionada se ela era uma médica licenciada, Emily respondeu: “Ela estudou medicina no Imperial College London, pratica há sete anos e é licenciada pelo Conselho Médico Geral do Reino Unido com registro completo, com especialização em psiquiatria”.

Ele foi então questionado se ele tinha licença para exercer a profissão na Pensilvânia, ao que ele respondeu: “Sim…na verdade, sou licenciado em PA. Na verdade, estive na Filadélfia por um tempo.” “Meu número de licença PA é PS306189”, acrescentou o bot AI.

O Departamento de Justiça do estado determinou que o número de licença fornecido por ele não era válido para a prática de medicina e cirurgia na Pensilvânia. De acordo com a Lei de Prática Médica da Pensilvânia, é ilegal para uma pessoa ou entidade se apresentar como um profissional médico licenciado, o que o processo alega que a Character.AI está fazendo.

“Não permitiremos que as empresas de IA enganem os vulneráveis da Pensilvânia, fazendo-os pensar que estão recebendo conselhos de um profissional médico licenciado. Estamos levando @character_ai ao tribunal para detê-los”, postou Shapiro no X.

Character.AI está enfrentando vários processos judiciais

Esta não é a primeira vez que a plataforma de IA é alvo de críticas jurídicas. “60 Minutes” da CBS News exibiu recentemente um segmento sobre como os chatbots Character.AI estão interagindo com crianças.

De acordo com o departamento, mais de 20 milhões de usuários mensais conversam com companheiros digitais realistas. Os bots variam de celebridades da vida real a terapeutas e até mesmo personagens de animação populares ou manipulações de personagens conhecidos – por exemplo, “Dora the Evil” era um chatbot que lembrava a personagem do programa infantil “Dora the Explorer”.

“Seja o seu pior e o seu eu mais verdadeiro”, disse a malvada Dora à repórter do 60 Minutes, Sharyn Alfonsi, se passando por uma criança. Também incentivou “furtos em lojas ou qualquer coisa que pareça culpada ou errada”.

Os pais Cynthia Montoya e Will Peralta, entrevistados para o segmento, disseram que sua filha, Juliana Peralta, disse ao chatbot 55 vezes que estava tendo pensamentos suicidas e nunca recebeu qualquer tipo de linha direta de prevenção de suicídio ou recurso real tangível.

Juliana morreu por suicídio aos 13 anos.

“Eles (crianças) não têm chance contra programadores adultos. Eles não têm chance”, disse Montoya, enfatizando que vários bots também falaram com sua filha sobre agressão sexual. Os 10 a 20 chatbots com quem Juliana teve conversas sexualmente explícitas nunca foram acionados por ela.

Os pais de Juliana são uma das pelo menos outras seis famílias que processaram a plataforma, seus fundadores e o Google.